Questo articolo è stato tradotto dall'AI

Ollama

Ollama è un software open-source che consente di eseguire modelli AI popolari, ad esempio Llama 3.2 o Gemma 2.

Questa è una guida passo-passo per installare e configurare Ollama per ONLYOFFICE Docs.

Connessione e configurazione di Ollama

- (Opzionale) Installa Homebrew se è il tuo metodo preferito per gestire i pacchetti su macOS e Linux:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)" - Per installare Ollama, esegui il seguente comando:

curl -fsSL https://ollama.com/install.sh | shPer Homebrew, esegui il seguente comando:

brew install ollamaUna volta installato, Ollama offre comandi per servire, elencare, ispezionare ed eseguire modelli sulla tua macchina.

- Segui questi passaggi per configurare Ollama:

- Avvia il server AI locale eseguendo il seguente comando nel Terminale:

export OLLAMA_ORIGINS=http://*,https://*,onlyoffice://* - Avvia Ollama ora e riavvia all'accesso:

brew services start ollama - In alternativa, se non è richiesto un servizio in background, esegui il seguente comando:

ollama serve

- Avvia il server AI locale eseguendo il seguente comando nel Terminale:

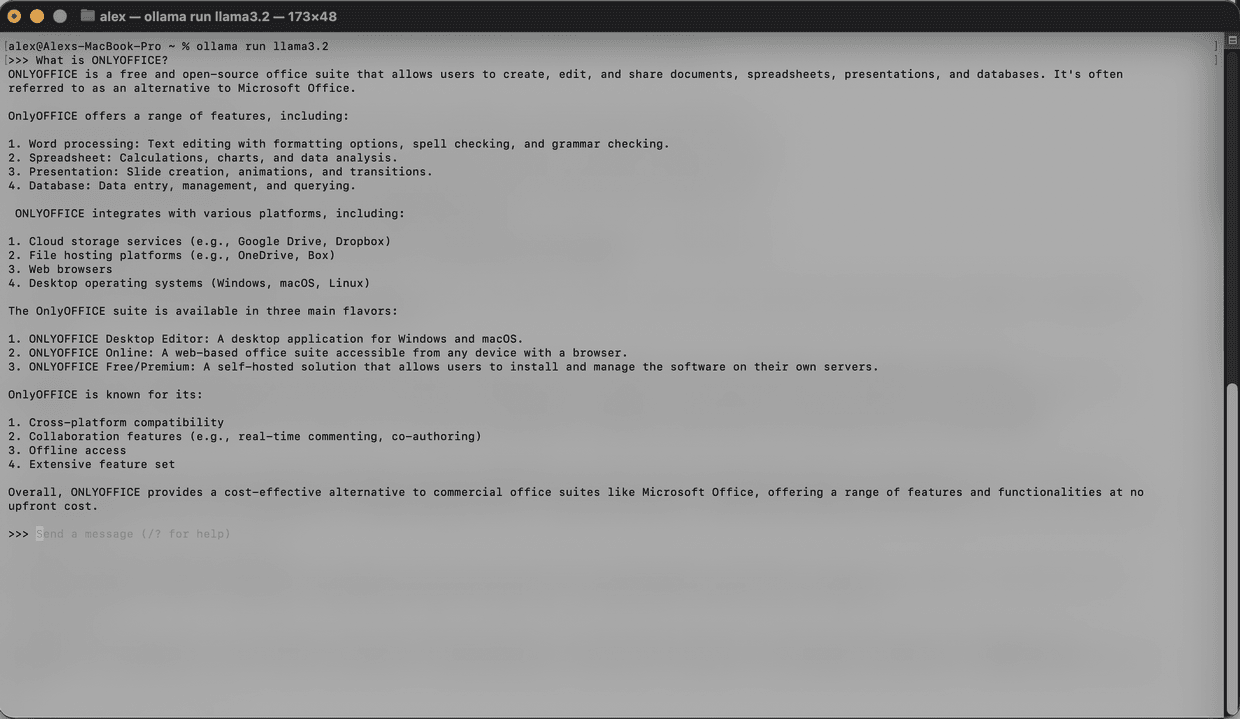

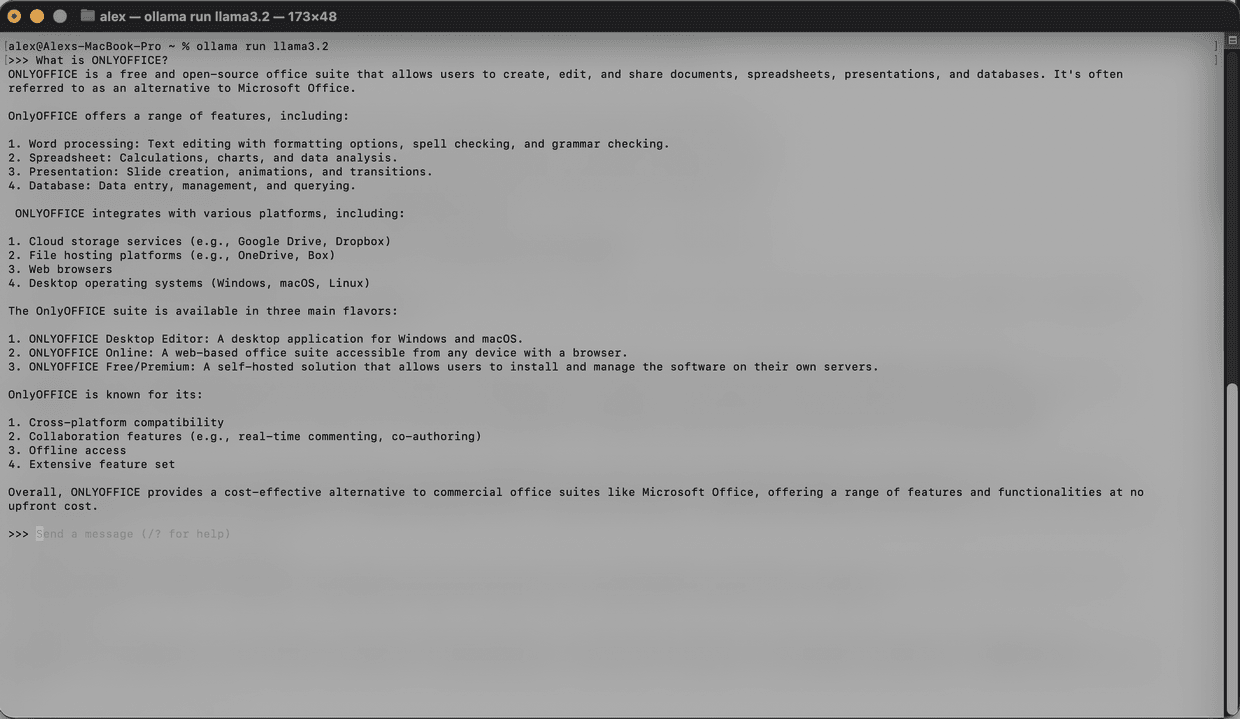

- Scarica il modello che desideri utilizzare in un'altra finestra del Terminale. Ad esempio, per installare ed eseguire Llama 3.2:

ollama run llama3.2

Il modello verrà scaricato e avviato localmente. Il numero totale di modelli installati è illimitato. Per l'elenco dei modelli disponibili, si prega di consultare la documentazione ufficiale di Ollama.

Prima dell'installazione, assicurati che la tua macchina abbia memoria e spazio su disco sufficienti per i modelli.

- Segui questa guida per la configurazione generale del plugin AI.

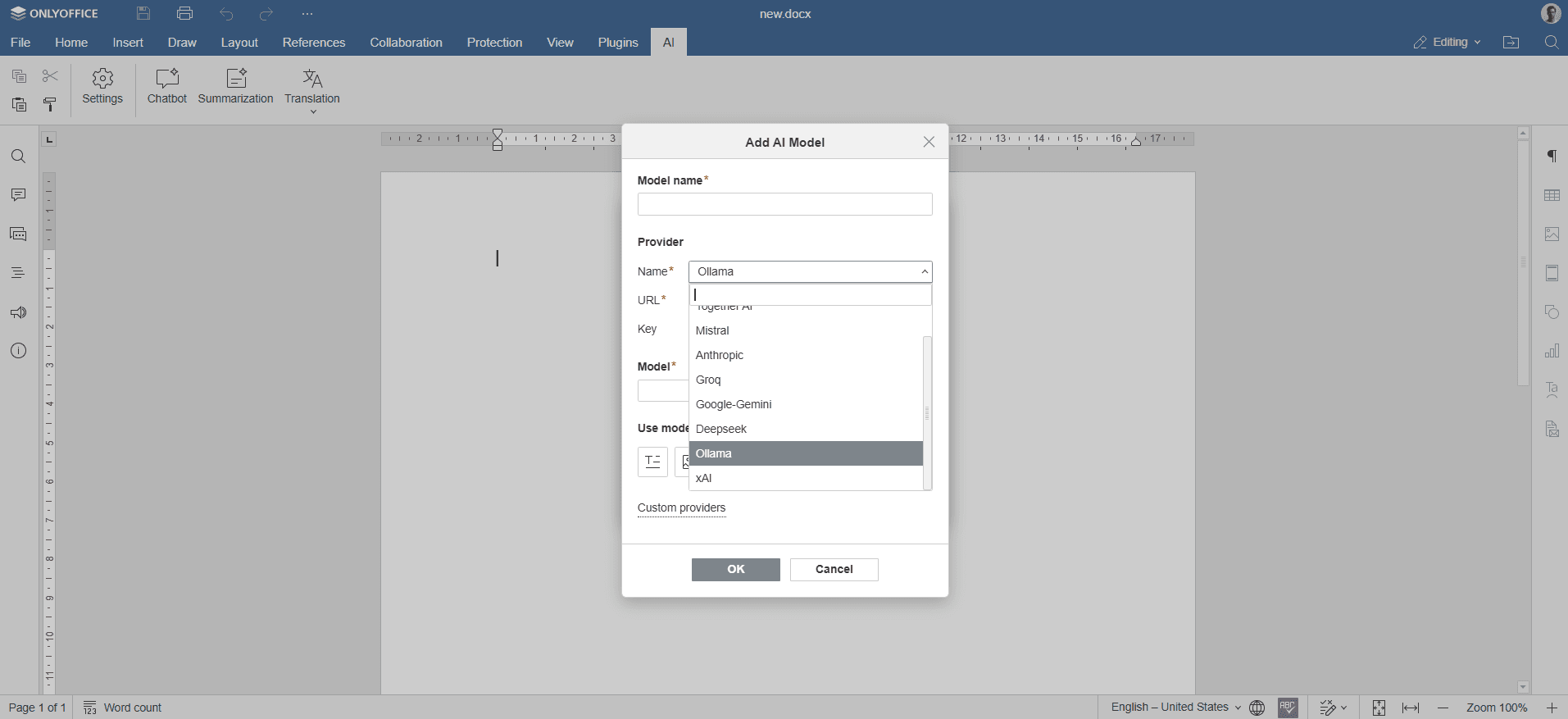

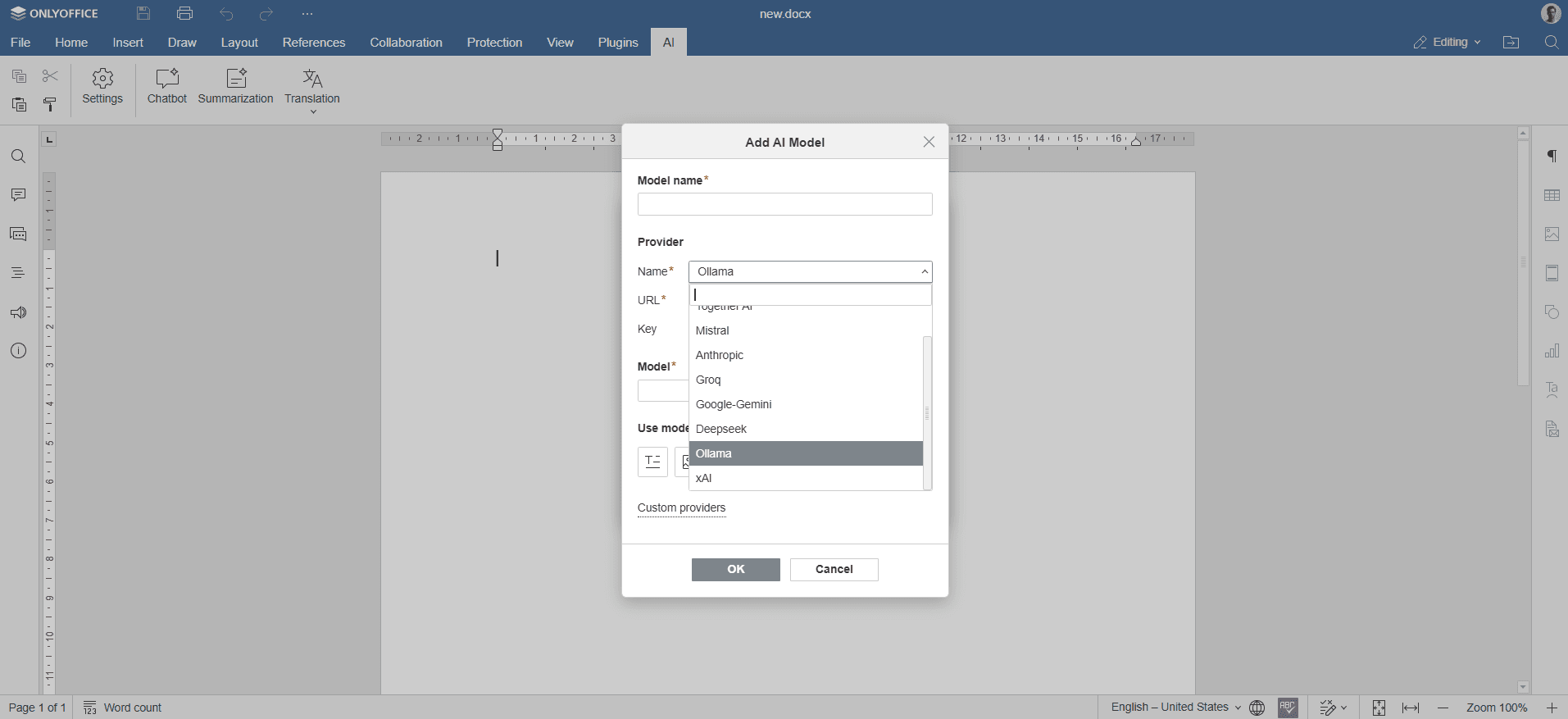

- Una volta installato il plugin, aggiungi modelli AI. Vai alla scheda AI e apri Impostazioni.

- Seleziona Modifica modelli AI nell'angolo in basso a sinistra della finestra e fai clic su Aggiungi.

- Nella finestra che appare, seleziona Ollama come fornitore e imposta l'URL su

http://localhost:11434.

- Seleziona il modello installato (ad esempio,

llama3.2:latest) dal menu a tendina e conferma. - Nella fila di icone, seleziona il modello utilizzato per: testo, immagini, embedding, elaborazione audio, moderazione dei contenuti, attività in tempo reale, aiuto alla codifica e analisi visiva.

- Fai clic su OK e chiudi la finestra. Il modello apparirà nell'elenco dei modelli disponibili nella lista dei modelli AI.

- Assegna diversi compiti all'AI. Dal menu a tendina, seleziona i modelli AI installati che svolgeranno questi compiti.

- Accedi alle funzionalità AI tramite la scheda AI o selezionando il testo e facendo clic con il tasto destro per aprire il menu contestuale.

Voci con l'etichetta tag:

Sfoglia tutti i tag