Questo articolo è stato tradotto dall'AI

LocalAI

LocalAI è l'alternativa gratuita e Open Source a OpenAI. Questa guida mostra come connettere LocalAI agli editor di ONLYOFFICE su Linux.

Si prega di notare che l'installazione tramite Docker è anche possibile. Per saperne di più, fare riferimento alla guida ufficiale di LocalAI su come procedere.

Passo 1: Installare LocalAI

Requisiti hardware

- CPU: un processore multicore.

- RAM: è richiesto un minimo di 8 GB; sono consigliati 16 GB o più.

- Archiviazione: è consigliato l'uso di un SSD. È richiesto un minimo di 20 GB.

- Rete: LocalAI funziona senza connessione a Internet. Tuttavia, è consigliata una connessione affidabile per scaricare modelli e applicare aggiornamenti.

Installazione

curl https://localai.io/install.sh | shPasso 2: Installare il modello richiesto

Utilizzare il seguente comando per installare il modello richiesto:

local-ai models install name_of_the_modeldove name_of_the_model è il nome del modello di cui hai bisogno.

Scopri di più sui modelli disponibili sul sito ufficiale di LocalAI.

Passo 3: Avviare LocalAI con il flag cors

Questo passaggio è necessario per utilizzare il tuo assistente AI non solo localmente, ma anche sul web.

local-ai run --corsIn alternativa, puoi aggiungere la seguente riga al file /etc/localai.env:

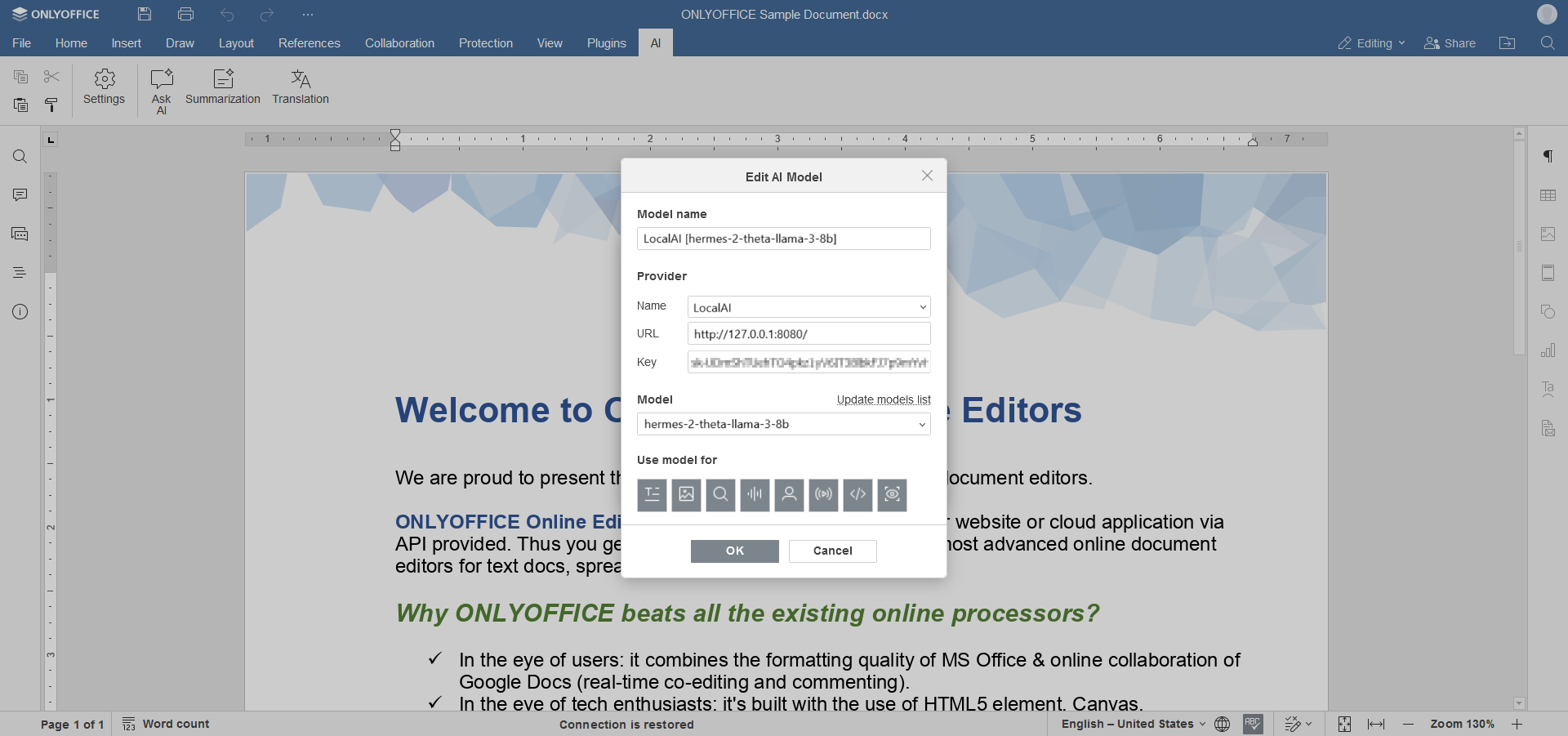

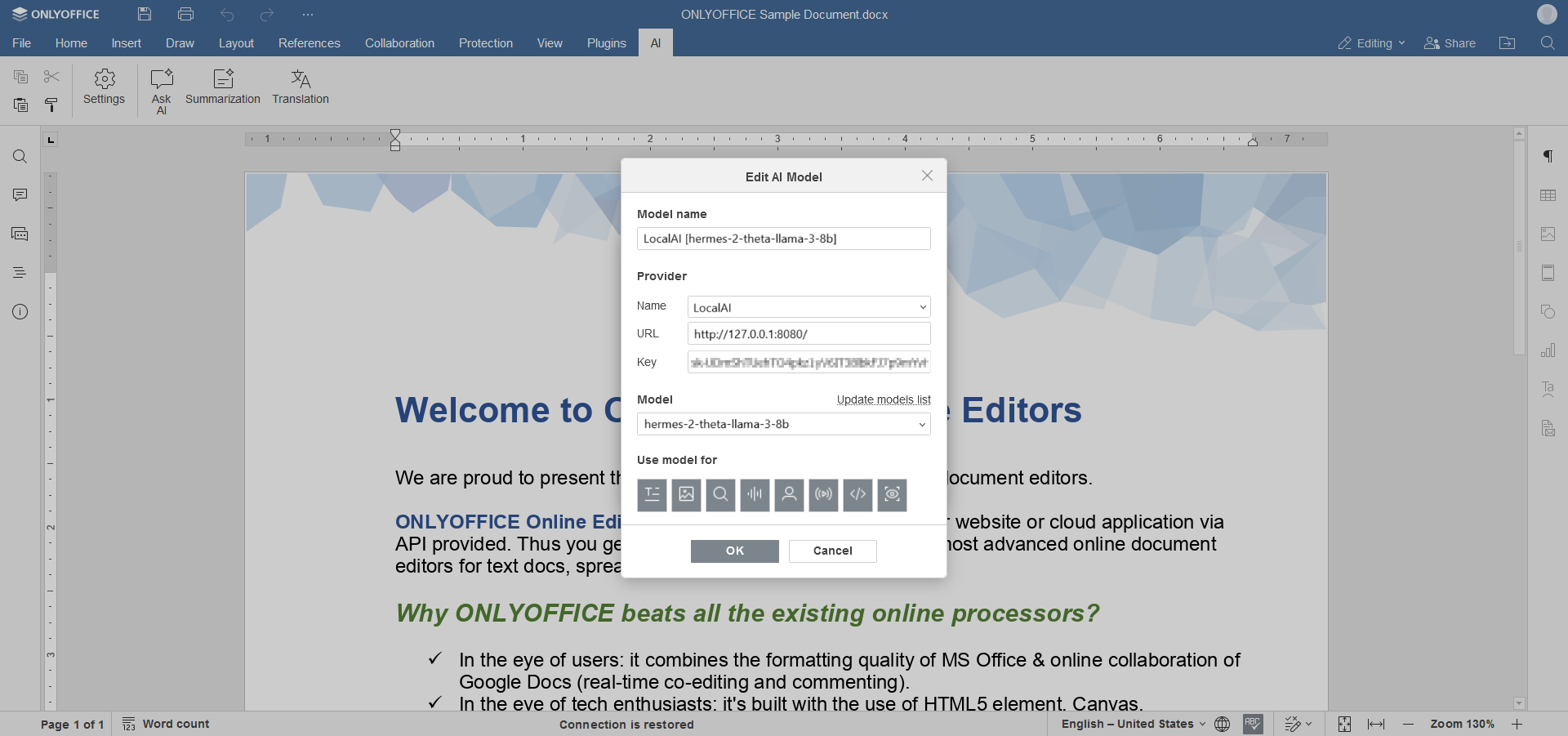

CORSALLOWEDORIGINS = "*"Passo 4: Configurare le impostazioni del plugin AI in ONLYOFFICE

- Si prega di fare riferimento alla nostra guida alla configurazione per la configurazione iniziale.

- Ora che hai connesso il tuo LocalAI agli editor di ONLYOFFICE, specifica LocalAI come nome del provider.

- Inserisci l'URL

http://127.0.0.1:8080se non lo hai cambiato quando hai avviato local-ai. - I modelli si caricheranno automaticamente nella lista – seleziona quello che hai scelto precedentemente nel passo 2 di questa guida.

- Clicca su OK per salvare le impostazioni.

Voci con l'etichetta tag:

Sfoglia tutti i tag