- Inicio

- IA

- Instalación

- Ollama

Ollama

Ollama es un software de código abierto que permite ejecutar modelos de IA populares, por ejemplo, Llama 3.2 o Gemma 2.

Esta es una guía paso a paso sobre cómo instalar y configurar Ollama para ONLYOFFICE Docs.

Requisitos del sistema

Los requisitos de hardware para Ollama dependen del tamaño del modelo que planeas ejecutar:

| Tamaño del modelo | RAM |

| 7B | 8 GB |

| 13B | 16 GB |

| 70B | 64 GB |

Se requiere al menos 4 GB de espacio en disco para el binario de Ollama. Se necesita espacio adicional para almacenar modelos, que pueden variar desde varios GB hasta cientos de GB dependiendo del modelo.

Se recomienda una GPU dedicada para un rendimiento aceptable. Ejecutar solo en CPU es posible, pero resultará en tiempos de respuesta significativamente más lentos.

Conectar y configurar Ollama

- (Opcional) Instala Homebrew si es tu forma preferida de gestionar paquetes en macOS y Linux:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)" - Para instalar Ollama, ejecuta el siguiente comando:

curl -fsSL https://ollama.com/install.sh | shPara Homebrew, ejecuta el siguiente comando:

brew install ollamaUna vez instalado, Ollama expone comandos para servir, listar, inspeccionar y ejecutar modelos en tu máquina.

- Sigue estos pasos para configurar Ollama:

- Lanza el servidor de IA local ejecutando el siguiente comando en la Terminal:

export OLLAMA_ORIGINS=http://*,https://*,onlyoffice://* - Inicia Ollama ahora y reinicia al iniciar sesión:

brew services start ollama - Alternativamente, si no se requiere un servicio en segundo plano, ejecuta el siguiente comando:

ollama serve

- Lanza el servidor de IA local ejecutando el siguiente comando en la Terminal:

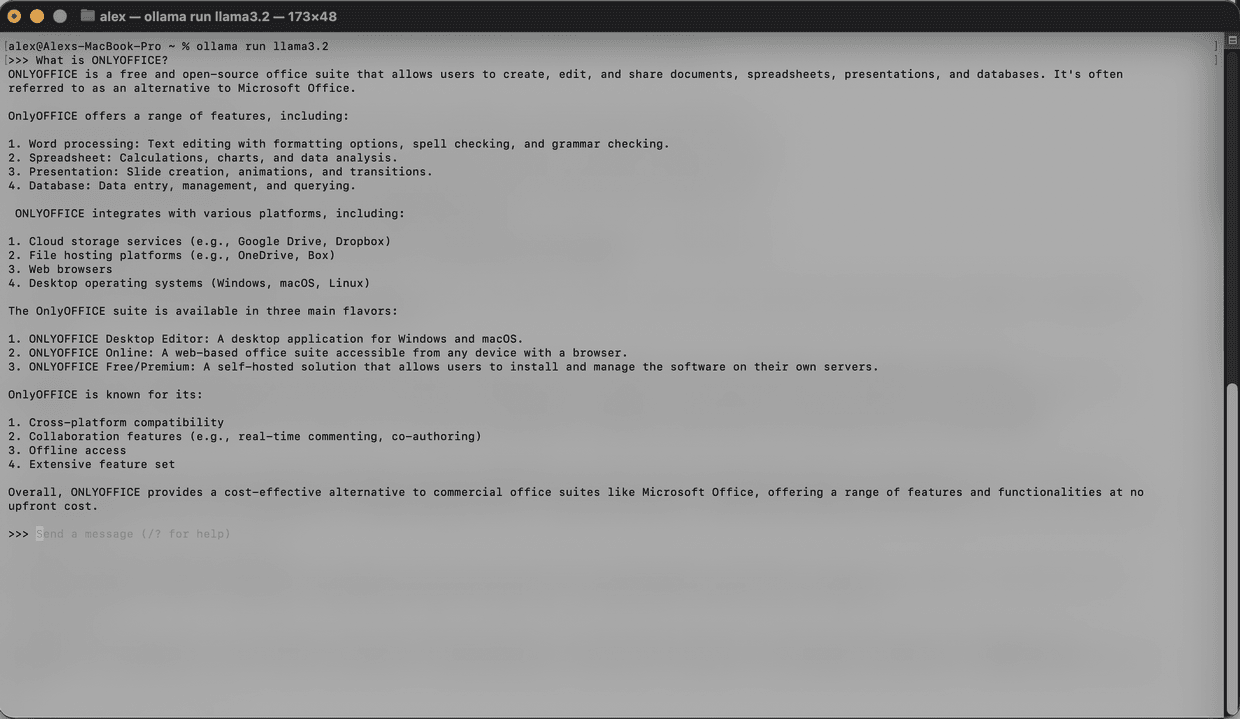

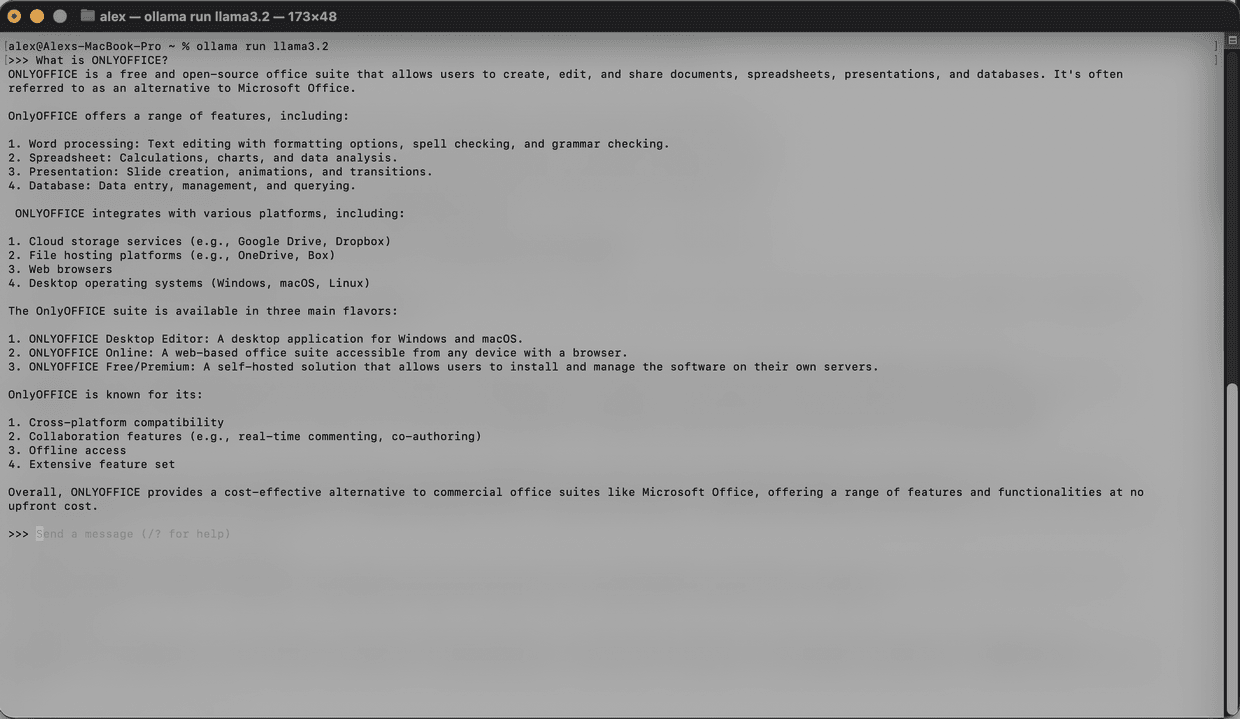

- Descarga el modelo que deseas usar en otra ventana de Terminal. Por ejemplo, para instalar y ejecutar Llama 3.2:

ollama run llama3.2

El modelo se descargará y se iniciará localmente. El número total de modelos instalados es ilimitado. Para la lista de modelos disponibles, consulta la documentación oficial de Ollama.

Antes de la instalación, asegúrate de que tu máquina tenga memoria y espacio en disco suficientes para los modelos.

- Sigue esta guía para la configuración general del plugin de IA.

- Una vez que el plugin esté instalado, añade modelos de IA. Ve a la pestaña IA y abre Configuración.

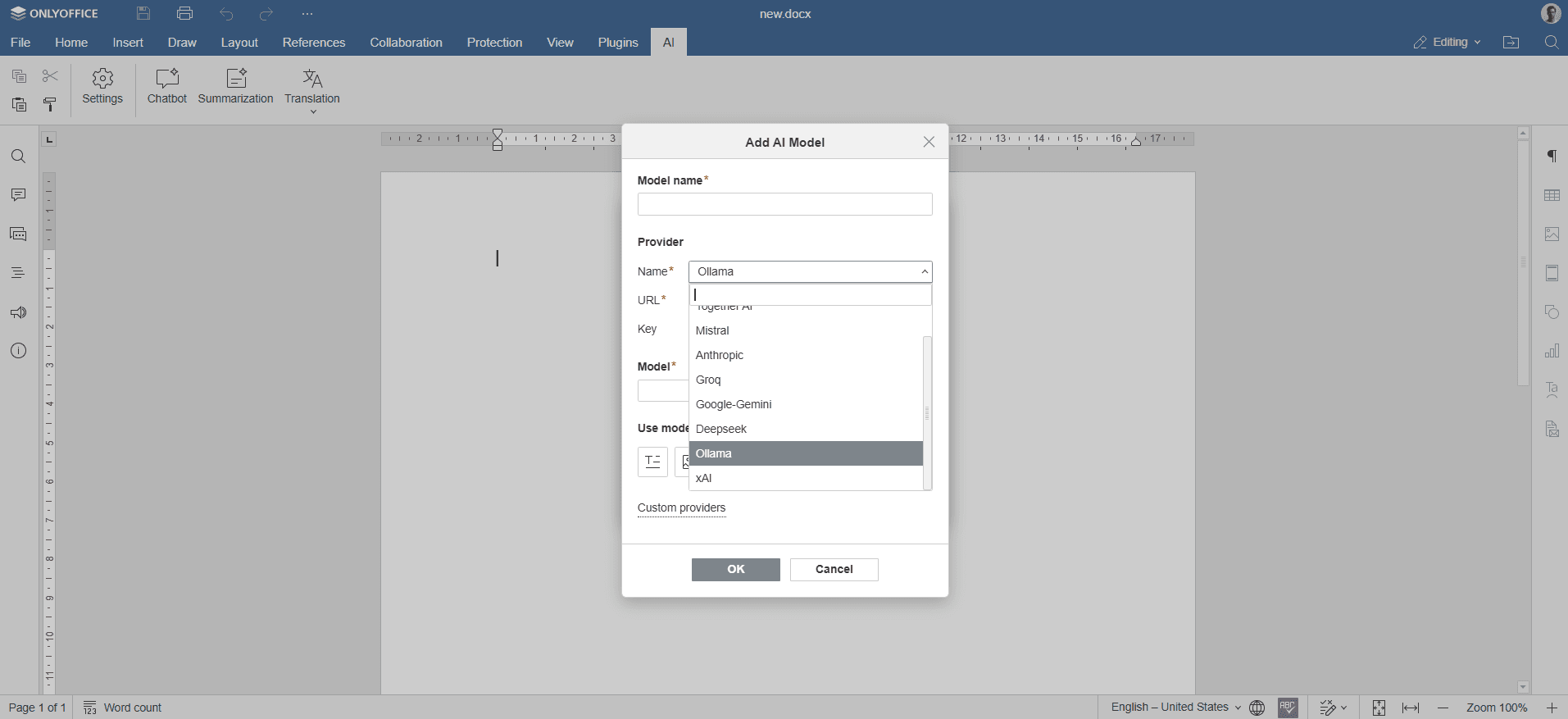

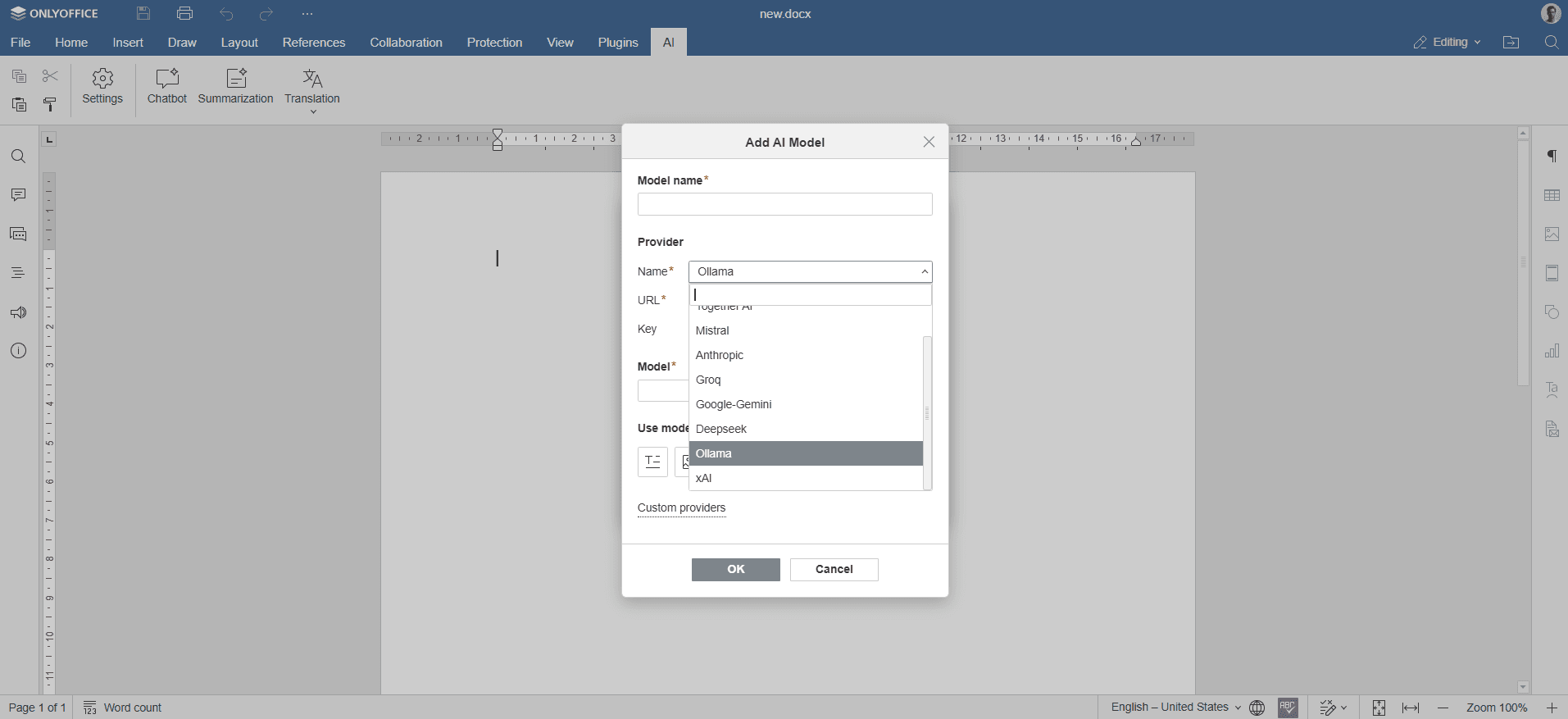

- Selecciona Editar modelos de IA en la esquina inferior izquierda de la ventana y haz clic en Añadir.

- En la ventana que aparece, selecciona Ollama como proveedor y establece la URL en

http://localhost:11434.

- Selecciona el modelo instalado (por ejemplo,

llama3.2:latest) de la lista desplegable y confirma. - En la fila de iconos, selecciona el modelo utilizado para: texto, imágenes, incrustaciones, procesamiento de audio, moderación de contenido, tareas en tiempo real, ayuda para codificación y análisis visual.

- Haz clic en OK y cierra la ventana. El modelo aparecerá en la lista de modelos disponibles en la lista de modelos de IA.

- Asigna diferentes tareas a la IA. Desde la lista desplegable, selecciona los modelos de IA instalados que realizarán estas tareas.

- Accede a las funciones de IA a través de la pestaña IA o seleccionando texto y haciendo clic derecho para abrir el menú contextual.