この記事はAIによって翻訳されました

LocalAI

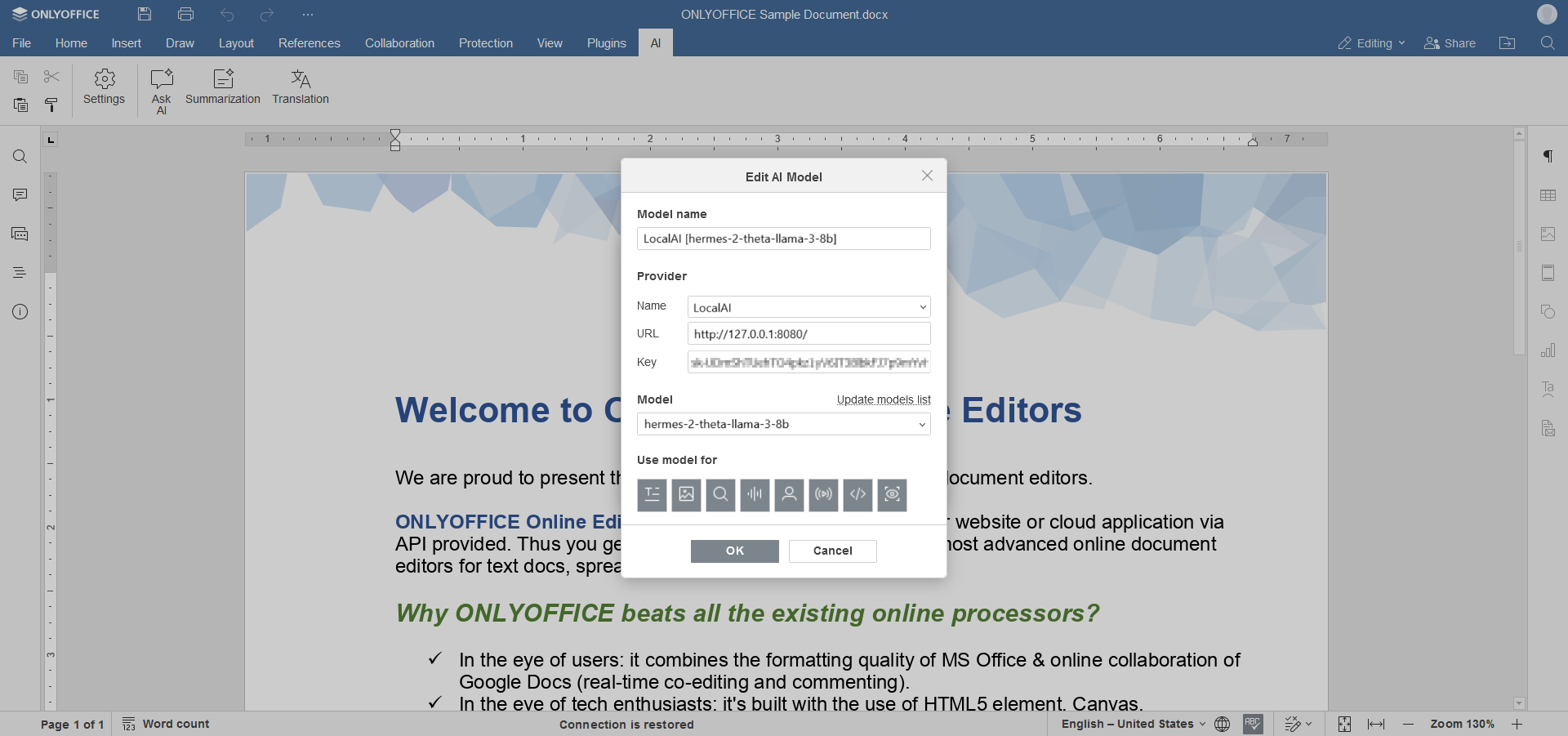

LocalAIは、無料でオープンソースのOpenAI代替ソリューションです。このガイドでは、Linux上でONLYOFFICEエディターにLocalAIを接続する方法を紹介します。

Dockerを使用したインストールも可能です。詳細については、公式LocalAIガイドをご参照ください。

ステップ1:LocalAIのインストール

ハードウェア要件

- CPU:マルチコアプロセッサ。

- RAM:最低8 GBが必要です。16 GB以上を推奨します。

- ストレージ:SSDストレージを推奨します。最低20 GBが必要です。

- ネットワーク:LocalAIはインターネット接続なしで機能しますが、モデルのダウンロードや更新の適用には信頼性のある接続が推奨されます。

インストール

curl https://localai.io/install.sh | shステップ2:必要なモデルのインストール

以下のコマンドを使用して必要なモデルをインストールします:

local-ai models install name_of_the_modelここで、name_of_the_modelは必要なモデルの名前です。

利用可能なモデルについては、公式LocalAIウェブサイトをご覧ください。

ステップ3:CORSフラグを使用してLocalAIを起動

このステップは、AIアシスタントをローカルだけでなくウェブでも使用するために必要です。

local-ai run --corsまたは、次の行を/etc/localai.envファイルに追加することもできます:

CORSALLOWEDORIGINS = "*"次の項目が含まれている記事:タグ:

すべてのタグを見る