- Inicio

- LocalAI

Este artículo está traducido por IA

LocalAI

LocalAI es la alternativa gratuita y de código abierto a OpenAI. Esta guía muestra cómo conectar LocalAI a los editores de ONLYOFFICE en Linux.

Tenga en cuenta que la instalación a través de Docker también es posible. Para obtener más información, consulte la guía oficial de Local AI sobre cómo hacerlo.

Paso 1: Instalación de LocalAI

Requisitos de hardware

- CPU: un procesador multinúcleo.

- RAM: se requiere un mínimo de 8 GB; se recomienda 16 GB o más.

- Almacenamiento: se recomienda almacenamiento SSD. Se requiere un mínimo de 20 GB.

- Red: LocalAI funciona sin conexión a Internet. Sin embargo, se aconseja una conexión fiable para descargar modelos y aplicar actualizaciones.

Instalación

curl https://localai.io/install.sh | shPaso 2: Instalación del modelo requerido

Utilice el siguiente comando para instalar el modelo requerido:

local-ai models install name_of_the_modeldonde name_of_the_model es el nombre del modelo que necesita.

Obtenga más información sobre los modelos disponibles en el sitio web oficial de LocalAI.

Paso 3: Lanzar LocalAI con la bandera cors

Este paso es necesario para utilizar su asistente de IA no solo localmente, sino también en la web.

local-ai run --corsAlternativamente, puede agregar la siguiente línea al archivo /etc/localai.env:

CORSALLOWEDORIGINS = "*"Paso 4: Configuración de los ajustes del plugin de IA en ONLYOFFICE

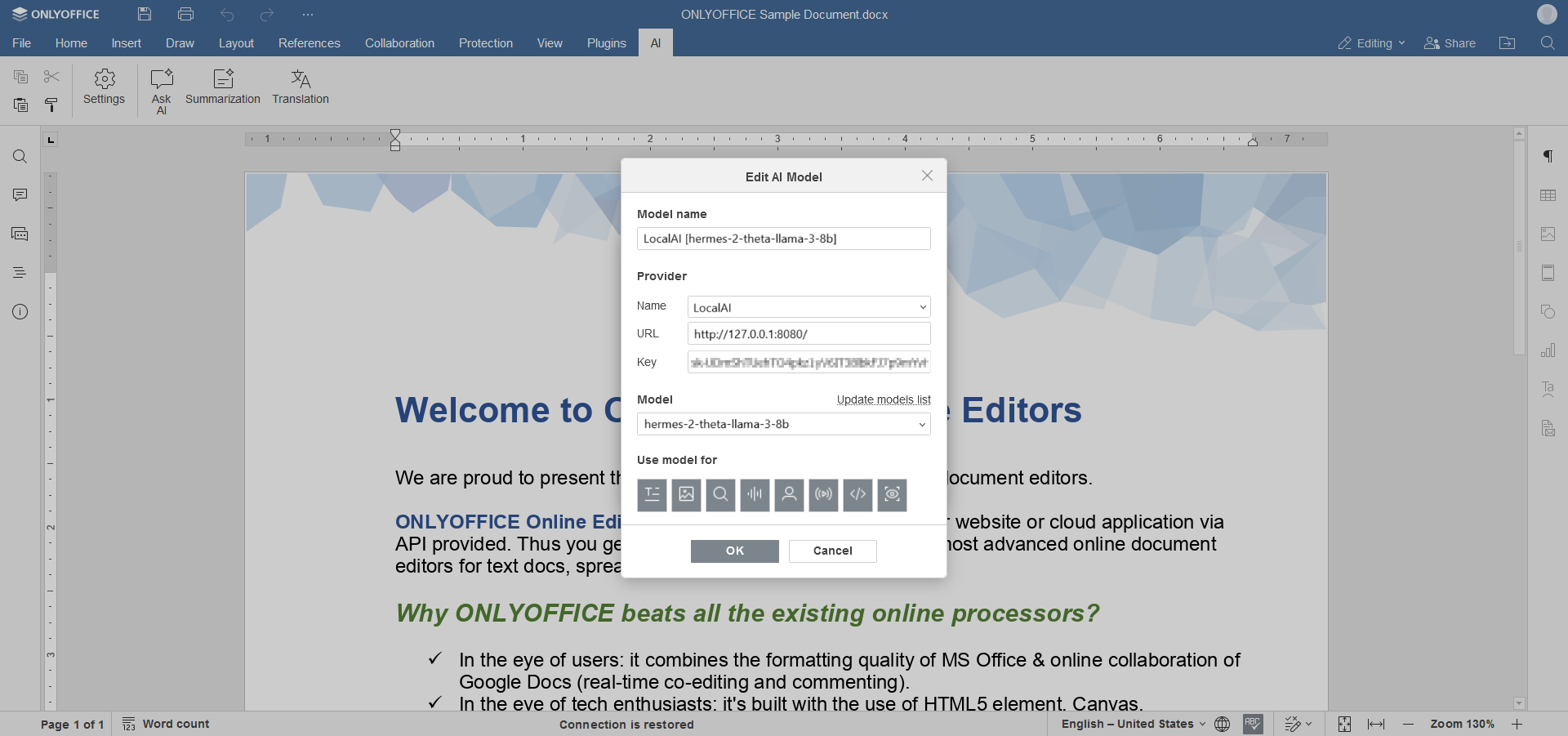

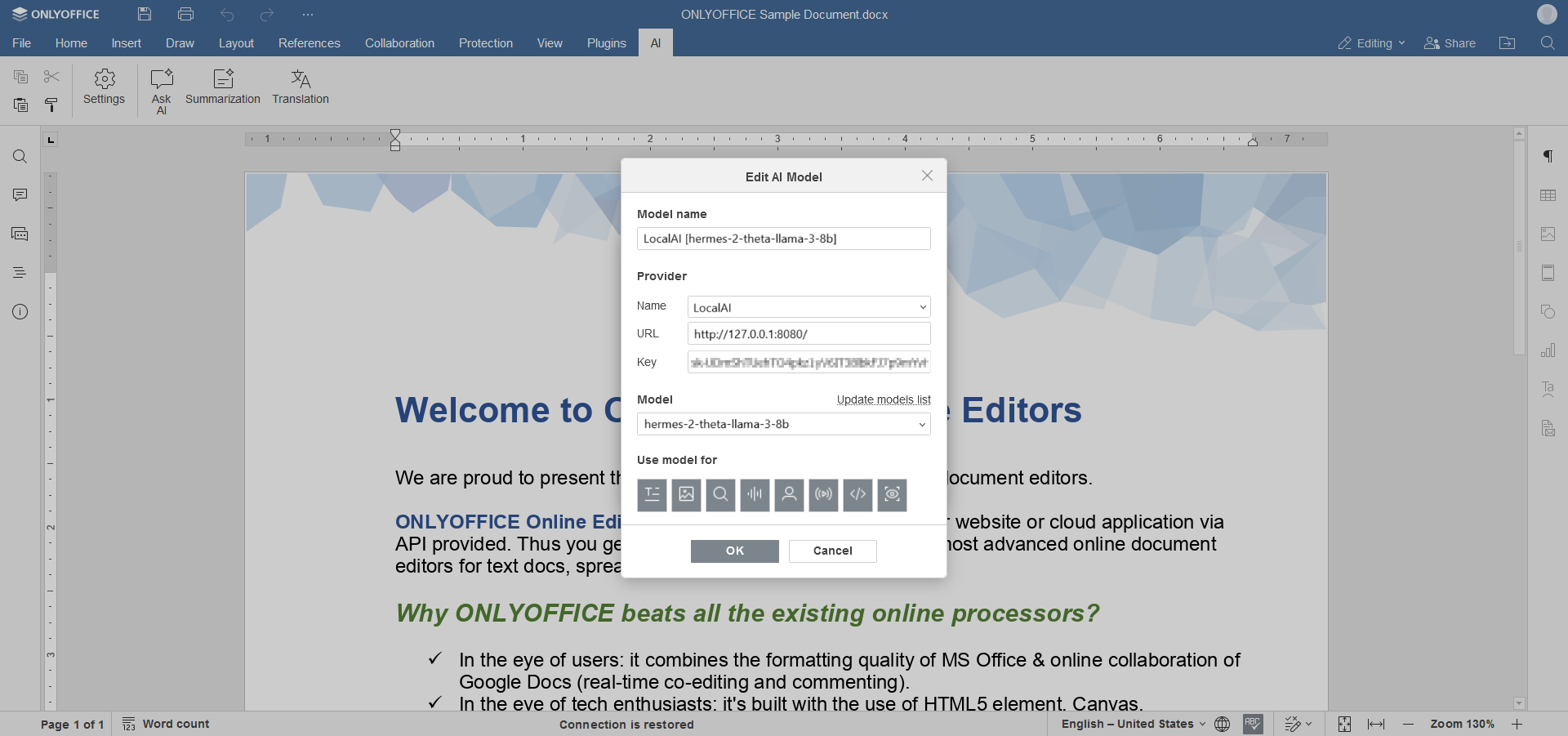

- Consulte nuestra guía de configuración para la configuración inicial.

- Ahora que ha conectado su LocalAI a los editores de ONLYOFFICE, especifique LocalAI como nombre del proveedor.

- Ingrese la URL

http://127.0.0.1:8080si no la cambió al iniciar local-ai. - Los modelos se cargarán automáticamente en la lista; seleccione el que eligió previamente en el paso 2 de esta guía.

- Haga clic en OK para guardar los ajustes.

Artículos con etiqueta:

Ver todas las etiquetas