- Home

- IA

- Installazione

- Ollama

Ollama

Ollama è un software open-source che consente di eseguire modelli popolari di IA, come Llama 3.2 o Gemma 2.

Questa guida spiegherà passo dopo passo come installare e configurare Ollama per ONLYOFFICE Docs.

Requisiti di sistema

I requisiti hardware per Ollama dipendono dalla dimensione del modello che si intende eseguire:

| Dimensione del modello | RAM |

| 7B | 8 GB |

| 13B | 16 GB |

| 70B | 64 GB |

Sono richiesti almeno 4 GB di spazio su disco per il binario di Ollama. È inoltre necessario spazio aggiuntivo per archiviare i modelli, che possono occupare da alcuni GB fino a centinaia di GB, a seconda del modello scelto.

Per ottenere prestazioni adeguate, si consiglia l'utilizzo di una GPU dedicata. L'esecuzione solo su CPU è possibile, ma comporta tempi di risposta significativamente più lunghi.

Collegamento e configurazione di Ollama

- (Opzionale) Installa Homebrew se preferisci utilizzarlo per la gestione dei pacchetti su macOS e Linux:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)" - Per installare Ollama, esegui il seguente comando:

curl -fsSL https://ollama.com/install.sh | shSe utilizzi Homebrew, esegui inveece il seguente comando:

brew install ollamaUna volta installato, Ollama mette a disposizione comandi per avviare il servizio, elencare, ispezionare ed eseguire modelli direttamente sulla macchina locale.

- Segui questi passaggi per configurare Ollama:

- Avvia il server AI locale eseguendo il seguente comando nel Terminale:

export OLLAMA_ORIGINS=http://*,https://*,onlyoffice://* - Avvia Ollama come servizio e abilitalo all'avvio:

brew services start ollama - In alternativa, se non hai bisogno di eseguirlo come servizio in background, usa il seguente comando:

ollama serve

- Avvia il server AI locale eseguendo il seguente comando nel Terminale:

- Scarica il modello che desideri utilizzare in un'altra finestra del Terminale. Ad esempio, per installare ed eseguire Llama 3.2:

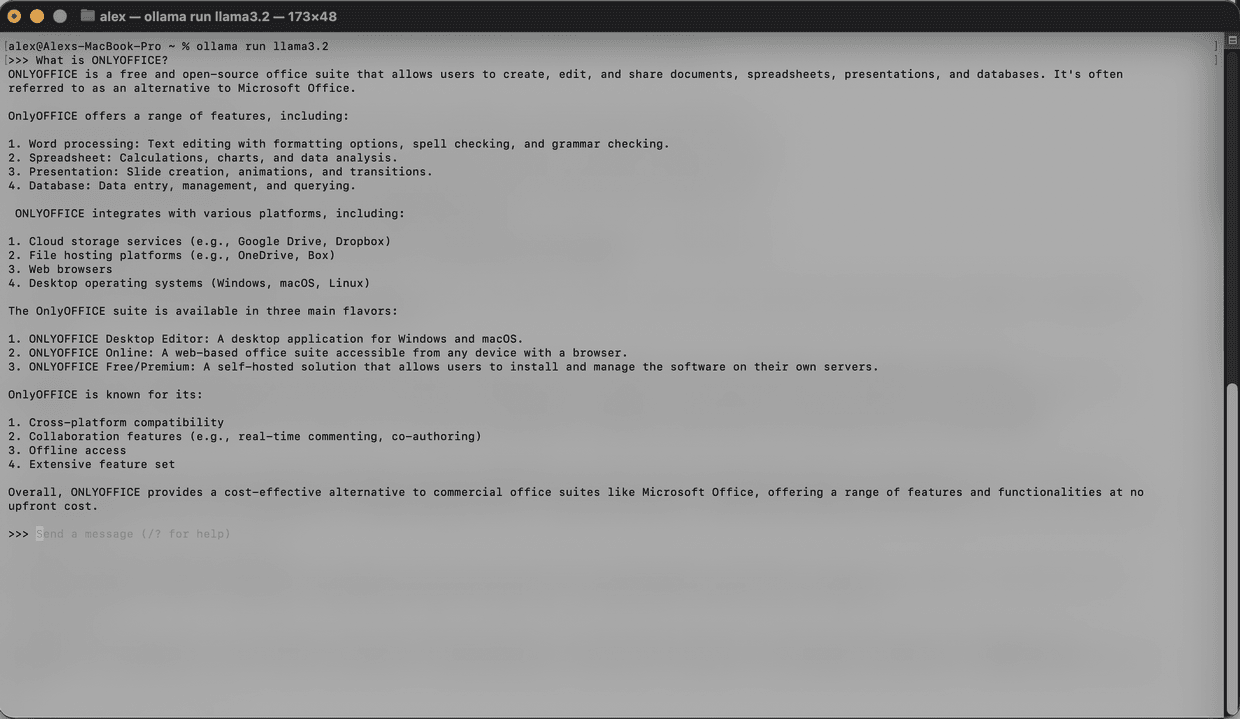

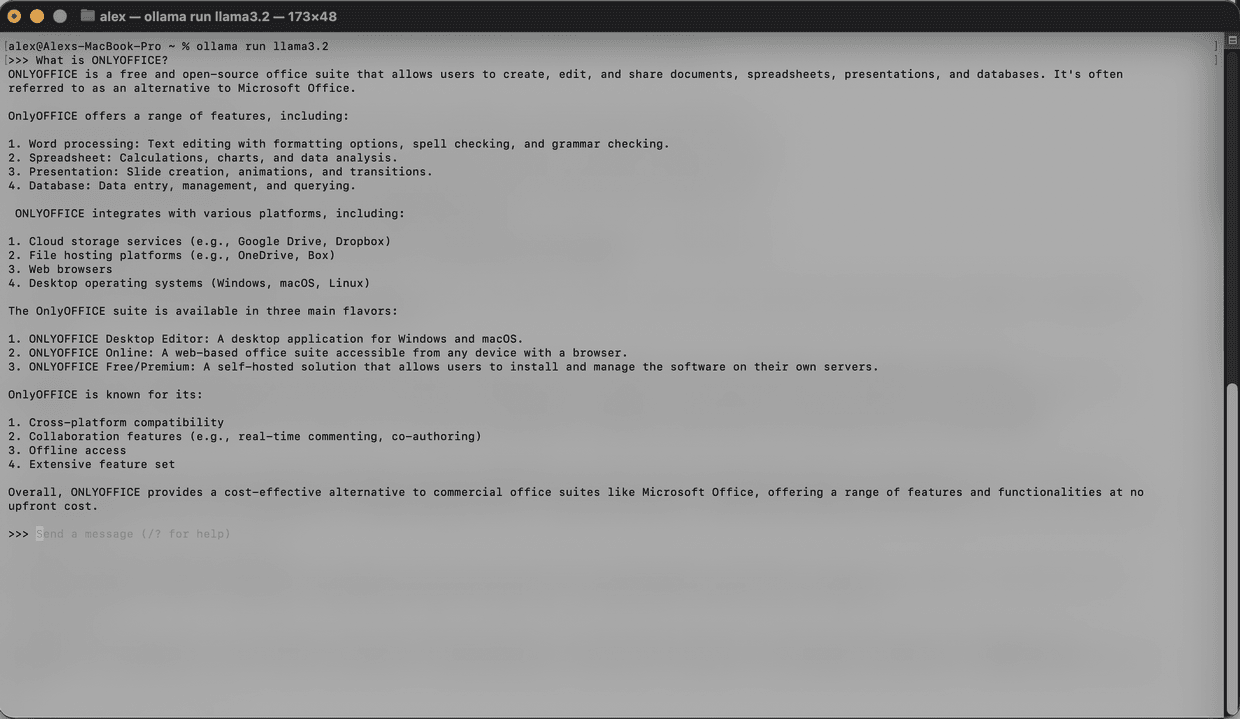

ollama run llama3.2

Il modello verrà scaricato e avviato localmente. Non esiste un limite al numero di modelli installabili. Per consultare l'elenco dei modelli disponibili, fai riferimento alla documentazione ufficiale di Ollama.

Prima dell'installazione, assicurati che il sistema disponda di memoria e spazio su disco sufficienti per i modelli scelti.

- Segui questa guida per la configurazione generale del plugin AI.

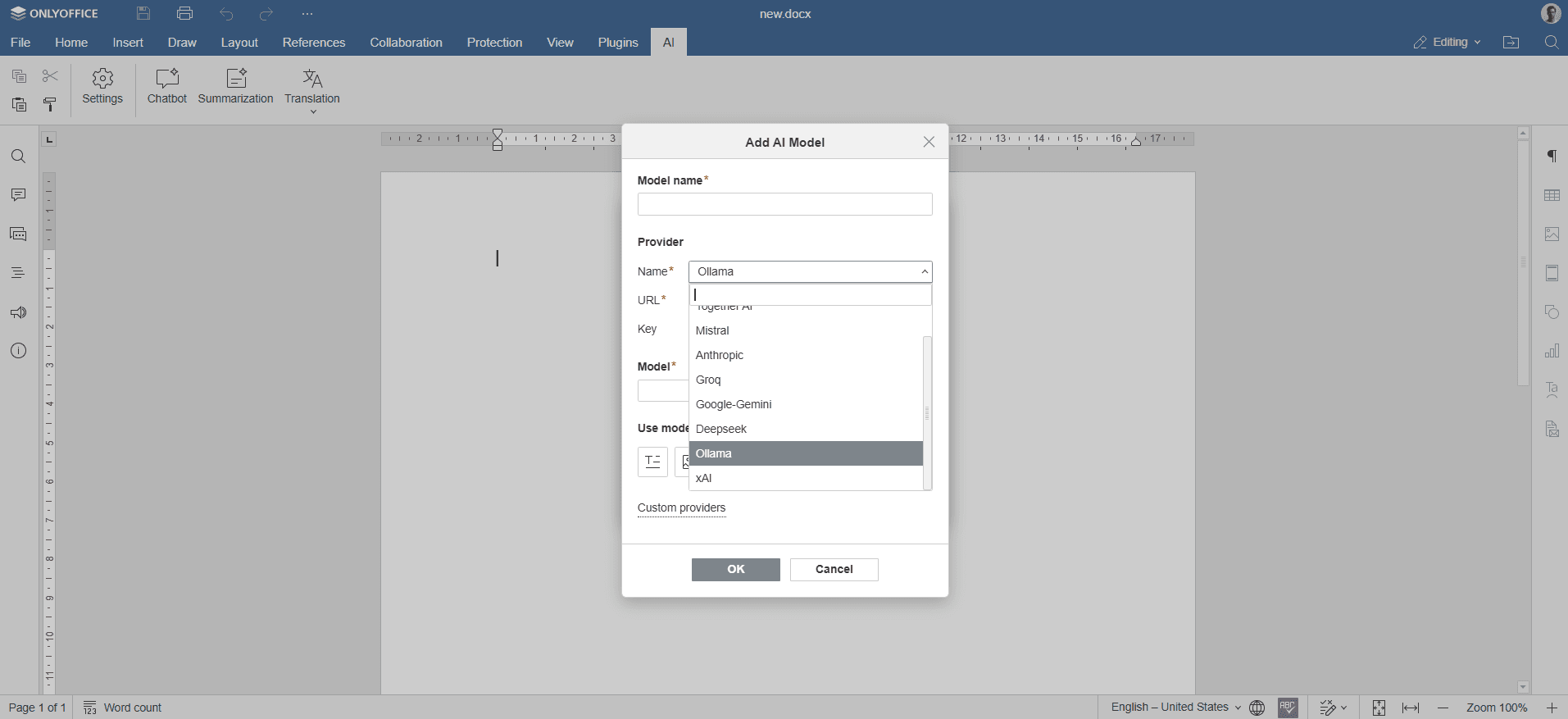

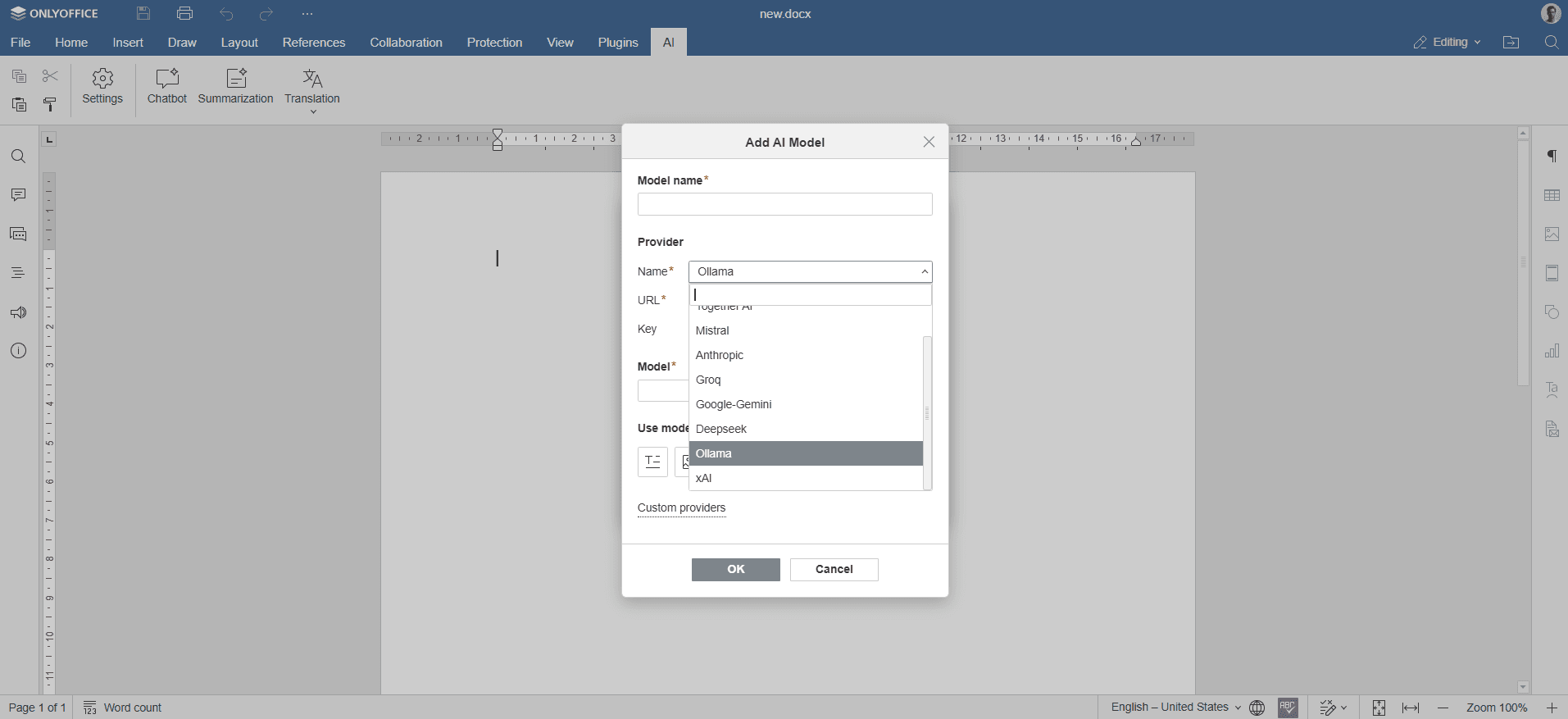

- Una volta installato il plugin, aggiungi i modelli AI. Vai alla scheda AI e apri Impostazioni.

- Seleziona Modifica modelli AI nell'angolo in basso a sinistra e fai clic su Aggiungi.

- Si aprirà una finestra; seleziona Ollama come fornitore e imposta l'URL su

http://localhost:11434.

- Seleziona il modello installato (ad esempio,

llama3.2:latest) dal menù a tendina e conferma. - Nella barra in basso, seleziona il modello da utilizzare per ciascuna funzione: "Testo", "Immagini", "Incorporamenti", "Elaborazione audio", "Moderazione dei contenuti", "Attività in tempo reale", "Assistenza per la codifica" e "Analisi visiva".

- Fai clic su OK e chiudi la finestra. Il modello apparirà nell'elenco dei modelli IA disponibili.

- Assegna le varie funzioni all'IA. Dal menù a tendina, seleziona i modelli IA installati che dovranno eseguirle.

- Accedi alle funzionalità IA tramite la scheda IA oppure selezionando il testo e facendo clic con il tasto destro per aprire il menu contestuale.